Auditive Wahrnehmung, Psychologie des Hörens

1. Gegenstand der auditiven Wahrnehmung

Der Prozess der Wahrnehmung gehört zu unseren elementaren kognitiven Funktionen. Die Wahrnehmungspsychologie beschäftigt sich damit, wie die sensorischen, physikalischen Reize in unserer Umwelt von unseren Sinnen aufgenommen und verarbeitet werden. Bei allen Sinnen treffen äußere Reize zunächst auf Sinneszellen, wo bereits eine erste Verarbeitung stattfindet. Die elektrischen Signale, die von dort ausgesendet werden, durchlaufen über Nervenbahnen verschiedene neuronale Zwischenstationen, bis sie schließlich im Cortex eintreffen. Dort lösen sie eine Empfindung oder eine Reaktion aus und dort erfolgt dann eine weitere kognitive Verarbeitung.

Das Hören als einer der fünf Sinne spielte in der biologischen Entwicklung eine große Rolle für die Orientierung im Raum, zur Erkennung von Gefahren aus der Umwelt usw. Nicht zuletzt spielt das Hören auch eine wesentliche Rolle bei der zwischenmenschlichen Kommunikation, d.h. bei der Sprache, und natürlich auch bei der Musik.

Speziell befasst sich die auditive Wahrnehmungspsychologie mit der Verarbeitung von Schallreizen durch den Menschen. Als Gegenstand betrachten wir dabei allerdings nicht jeden Schall, sondern nur natürlich jenen, den wir (mit den Ohren) wahrnehmen können. Betrachtet werden dabei die Beziehungen zwischen dem äußeren, physikalischen Reiz, dem Schall, und der inneren, subjektiven Empfindung, der Hörempfindung. Schall wird durch Schwingungen der Luftmoleküle (oder der Knochen) übertragen, die das auditorische System stimulieren. Bestimmte Merkmale dieser Schwingungen (Amplitude, Frequenz und Obertonspektrum) werden letztlich als Lautstärke, Tonhöhe und Klangfarbe empfunden.

Schall, der in unser Ohr dringt, regt spezielle Sinneszellen im Innenohr an. Im peripheren System findet dann bereits eine Vorverarbeitung statt, bevor die ausgelösten elektrischen Impulse über den Hörnerv ins Hörzentrum, den auditorischen Cortex, geleitet werden. Dort wird dann nach weiteren Verarbeitungsprozessen aus dem sensorischen Input schließlich ein "Abbild" von der Außenwelt erzeugt. Letztes Endes ist die auditive Wahrnehmung also nicht die abstrakte Wahrnehmung von Schall an sich, sondern eine Objektwahrnehmung, d.h. sie dient der Wahrnehmung von Objekten und von Ereignissen, die den wahrgenommenen Schall erzeugen.

2. Akustik

2.1 Was ist Schall?

Allgemein bezeichnet Schall mechanische Schwingungen von Partikeln in einem elastischen Medium. Mechanische Schwingungen gehen von schwingenden Körpern aus, die man allgemein als Schallquellen bezeichnet. Solche Schallquellen können z. B. Musikinstrumente, menschliche Stimmen, Motoren, Lautsprecher sein.

Um Schall entstehen zu lassen, muss die Schallquelle selbst in eine mechanische Schwingung versetzt sein. Die mechanischen Schwingungen breiten sich ausgehend von der Schallquelle strahlenförmig nach allen Richtungen aus. Durch die Schwingungen der Schallquelle werden die Partikel (z.B. die Luftmoleküle), die sich in der Nähe befinden, angestoßen, diese stoßen wiederum ihre Nachbarn an und so entsteht eine Druckwelle, die sich von der Schallquelle ausgehend strahlenförmig ausbreitet.

Eine schwingenden Saite z.B. bewegt sich periodisch hin und her (oder auf und ab). Dadurch wird die Luft um sie herum abwechselnd verdichtet und verdünnt.

Die Luftpartikel selbst bleiben eigentlich immer an demselben Ort, sie werden nur hin und her "geschubst", stoßen dadurch aber ihre Nachbarn an und

diese machen dann wiederum dasselbe. und so breitet sich eine mechanische Welle aus.

Dies kann man in diesen Animationen zur Wellenbewegung sehen (Quelle: www.acs.psu.edu/drussell/Demos/waves/wavemotion.html):

und

Es bilden sich also zeitlich wechselnd Bereiche mit größerer Teilchenanzahl (größerem Druck) und Bereiche mit kleinerer Teilchenanzahl (kleinerem Druck).

In der Luft sind Schallwellen also sich ausbreitende Schwankungen des Luftdrucks.

Da die Ausbreitungs- und die Schwingungsrichtung der Teilchen übereinstimmen, handelt es sich hier speziell um Längswellen (Longitudinalwellen).

Auch bei Schallwellen können wie bei anderen Wellen Reflexion, Brechung, Beugung, Interferenz, Dämpfung und Absorbtion auftreten. Schallwellen gibt es außerdem nicht nur in der Luft, sondern auch in festen und flüssigen Körpern, nicht aber im luftleeren Raum. In einem Vakuum können sich Schallwellen nicht ausbreiten, da sie immer ein Medium benötigen, das angeregt werden muss. Hierin unterscheiden sich Schallwellen zum Beispiel von elektromagnetischen Wellen.

Schall breitet sich in einem Stoff konstanter Temperatur geradlinig aus. Die Geschwindigkeit, mit der sich Schall ausbreitet, wird als Schallgeschwindigkeit bezeichnet. Sie ist für verschiedene Medien teilweise sehr unterschiedlich. In der Luft (bei 20° Celsius) beträgt sie etwa 343 Meter pro Sekunde, in festen Materialien zum Teil mehrere tausend Meter pro Sekunde.

2.2 Eigenschaften von Schall

Eine wichtige Eigenschaft von Schall ist seine Stärke, für die es verschiedene Größen bzw. Definitionen gibt:

- Schalldruck P: das ist die Kraft, die der Schall auf eine Fläche ausübt. Er wird gemessen in Pascal (Pa).

Der Schalldruck ist eine skalare Größe, d.h. er hat einen Betrag, aber keine Richtung.

Pascal ist die Einheit für Druck: Pa=N/m² und Newton die Einheit für Kraft: N=kg*m/s². Übrigens sind 10000 Pa = 1 bar. - Schallleistung L: die Menge an Schallenergie, die von einer Schallquelle pro Zeiteinheit abgegeben wird.

- Schallintensität I: die Stärke des Schalls an einem bestimmten Punkt in einem Medium, d.h. die Menge an Energie pro Zeit und Fläche. Die Schallintensität ist eine vektorielle Größe, d.h. sie hat einen Betrag und auch eine Richtung.

Den Verlauf der Schallintensität kann man mathematisch durch eine Schallfunktion I(t) beschreiben (Intensität in Abhängigkeit von der Zeit) und grafisch in einem Schwingungsdiagramm mit der Zeit als x-Achse und der Intensität (Amplitude) als y-Achse. In einem solchen Diagramm bewegt sich der y-Wert um die Null-Linie: positive Werte entsprechen einem Überdruck (einem "Wellenberg") und negative Werte einem Unterdruck (einem "Wellental"). An der Form, an der Dauer und am zeitlichen Verlauf der Funktion erkennt man auch die typischen Merkmale der verschiedenen Arten von Schall (Ton, Rauschen, Knall usw.).

Das menschliche Ohr ist in der Lage, Druckschwankungen von etwa 0,00002 Pa (Hörschwelle) bis etwa 20 Pa (Schmerzschwelle) wahrzunehmen.

Da die Dimension dieser Zahlenwerte sehr groß ist, benutzt man für Schallmessungen in der Praxis einerseits logarithmische Skalen

und andererseits das Verhältnis des interessierendes Wertes zu einem Bezugswert.

So ist etwa der Schalldruckpegel, oft mit SPL (Sound Pressure Level) abgekürzt, und seine Einheit, die Dezibel-Skala, definiert

als der 20fache dekadische Logarithmus des Verhältnisses zwischen dem Effektivwert des gemessenen Schalldrucks (p1)

zu einem Bezugsschalldruck (p0):

Die ursprüngliche Einheit für den Schalldruckpegel ist eigentlich Bel.

Aus praktischen Gründen nimmt ein Zehntel davon, d.h. 1 Bel = 10 dB.

Und weil außerdem die Schallenergie vom Quadrat der p-Werte anhängt,

kommt insgesamt der Faktor 2*10 = 20 vor den Logarithmus.

Nimmt man wie üblich als Bezugsschalldruck p0 die Hörschwelle 0,00002 Pa (0 dB),

so liegt die Schmerzschwelle (Schalldruck p1 von 20 Pa) bei 120 dB:

Schallwellen können periodisch oder nicht-periodisch sein. Die Schallwellen von Tönen und Klängen sind periodisch, jene von Geräuschen (Rauschen, Knall, etc) sind Beispiele für nicht-periodische Schallwellen. Eine schwingende Schallquelle (z.B. eine Saite) erzeugt eine mehr oder weniger komplexe Schallwelle. Die Schallfunktion ist periodisch, d.h. sie wiederholt sich immer wieder nach einer bestimmten minimalen Zeit, der Periodenlänge T. Andersherum, wenn man die Schallwelle räumlich betrachtet, so wiederholt sich das Hin und Her (ihre Form) nach einer bestimmten minimalen Länge, der Wellenlänge. Die Periodenlänge wird meist in Sekunden angegeben. Fragt man andersherum, wieviele Perioden in einer Sekunde verstreichen, so kommt man zum Begriff der Frequenz f. Es gilt: Die Frequenz wird allgemein in Hertz (Hz) oder in Kilohertz (kHz) angegeben. Bei einer Stimmgabel für den Kammerton A beträgt die Frequenz 440 Hz (d.h. 440 Perioden pro Sekunde). Um übrigens eine Größenordnung von der Länge einer Schallwelle zu bekommen, folgendes Beispiel: beim eben erwähnten Kammerton beträgt die Wellenlänge (die Länge einer Periode) ungefähr 3/4 m. Insgesamt liegen die Schallwellenlängen zwischen 17 m (bei 20 Hz) und 1,7 cm (bei 20 kHz).

2.3 Die Sinusfunktion

Die einfachste periodische Welle ist die Sinuswelle. In der Natur kommen Sinustöne normalerweise nicht vor. Allerdings kann man sie mit hohem technischen Aufwand im Labor und im Tonstudio erzeugen. Die in der Natur oder in der Musik auftretenden Schallwellen zeigen immer mehr oder weniger komplexe Schwingungsmuster. Die Sinusschwingung ist andererseits aber die Grundlage bei der Erforschung aller komplexen Schallwellen, beispielsweise und vor allem auch bei der Analyse und Synthese von musikalischen Tönen. Man kann nämlich zeigen, dass jede noch so komplexe periodische Welle sich eindeutig darstellen lässt als eine Überlagerung von Sinuswellen mit bestimmten, festen Frequenzen mit bestimmten, festen Amplituden. Dieser überaus wichtige Satz und das entsprechende mathematische Verfahren dafür ist die Fourieranalyse (siehe unten).

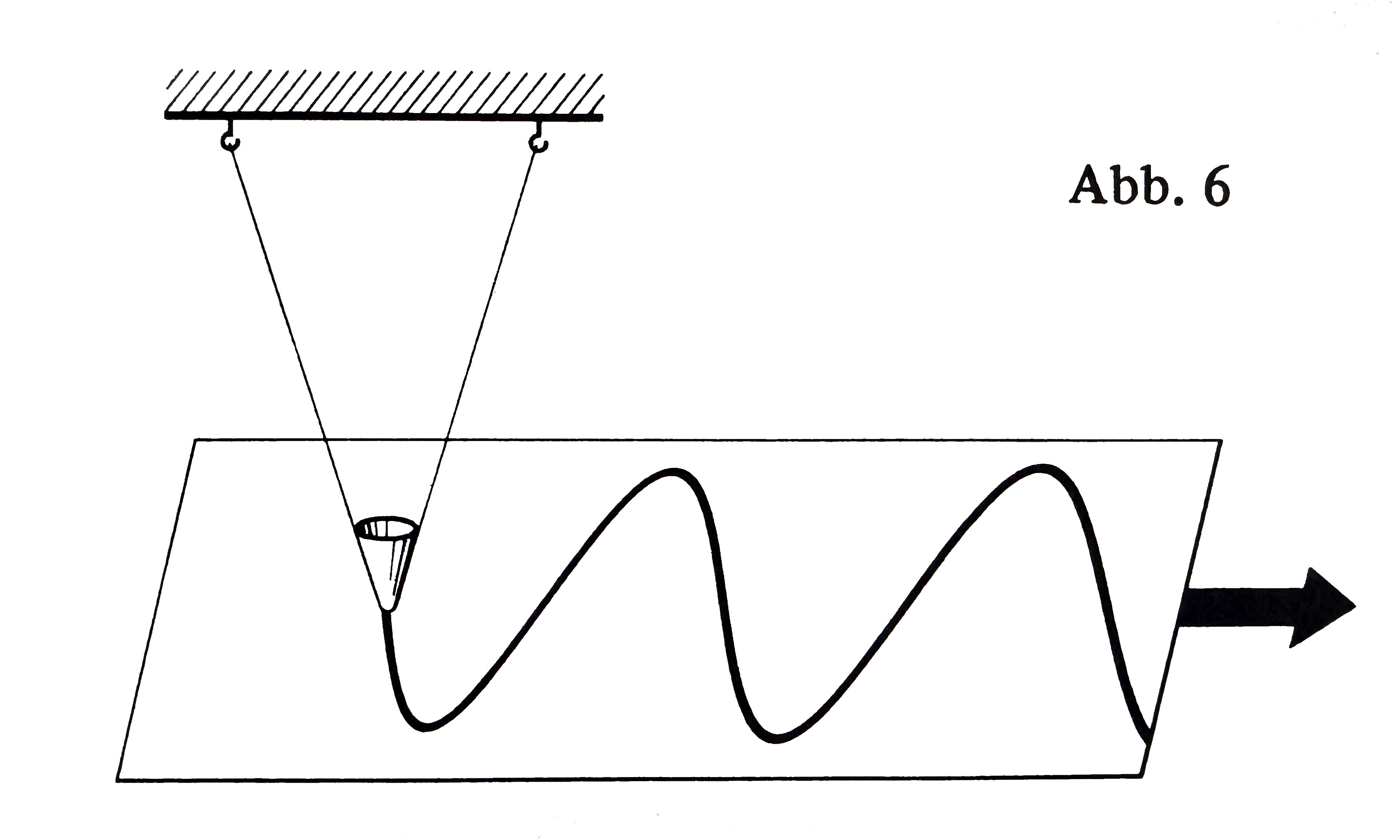

Die Sinusfunktion ist übrigens die mathematische Funktion, die man auch aus der harmonischen Schwingung eines Pendels

(Federpendel, Uhrpendel) ableiten kann, wenn man die Stellung (Auslenkung) des Pendels in Abhängigkeit von der Zeit abträgt.

aus Borucki: Einführung in die Akustik (1980)

aus Borucki: Einführung in die Akustik (1980)

siehe auch die Animation mit dem Federpendel (Quelle: https://de.wikipedia.org/wiki/Schwingung)

Eine weitere mit der Schwingung eines Pendels verwandte harmonische Bewegung ist die Bewegung auf dem Einheitskreis:

hier beschreibt die Sinusfunktion die vertikale Komponente der Kreisbewegung.

Zwei Animationen dazu:

Animation Sinusfunktion am Einheitskreis

Einheitskreis mit Sinus und Kosinusfunktion (https://commons.wikimedia.org)

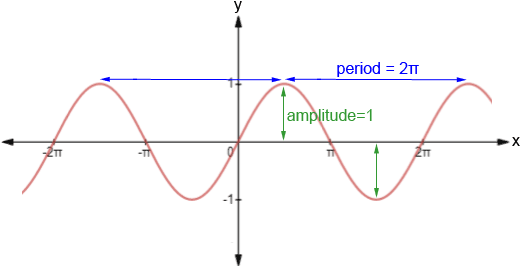

Die mathematische Formel für die allgemeine Sinusfunktion lautet:

t ist die Zeit bzw. der Winkel, a ist die Amplitude, f die Frequenz und φ die Phasenverschiebung (Links-/Rechtsverschiebung).

Bei dieser Grafik ist die Phasenverschiebung gleich 0, d.h. die Funktion geht durch den Ursprung.

Der hörbare Frequenzbereich des Menschen liegt zwischen 20 und 20000 Hz. Schall unterhalb dieses Bereichs wird als Infraschall bezeichnet und jener oberhalb als Ultraschall. Mit steigendem Lebensalter nimmt die obere Hörschwelle beim Menschen merklich ab, d.h. sie liegt dann nicht mehr bei 20 kHz, sondern nur noch bei der Hälfte oder noch weniger.

Die Empfindlichkeit für verschiedene Frequenzen hängt allerdings auch von der Lautstärke ab.

Es ist sowohl die Hörschwelle als auch die Schmerzschwelle frequenzabhängig.

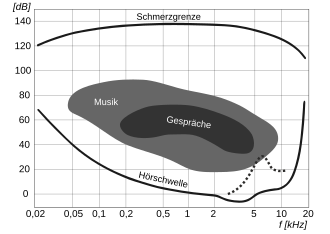

Grafisch wird dies dargestellt in der sog. Hörfläche des normalhörenden Menschen:

diese zeigt für jede Frequenz den Bereich zwischen der Hörschwelle und der Schmerzschwelle

Nicht nur der überhaupt hörbare Bereich ist frequenzabhängig, sondern auch das subjektive Lautstärkeempfinden

(die subjektive Lautheit),

d.h. wie laut ein bestimmter Schall subjektiv empfunden wird.

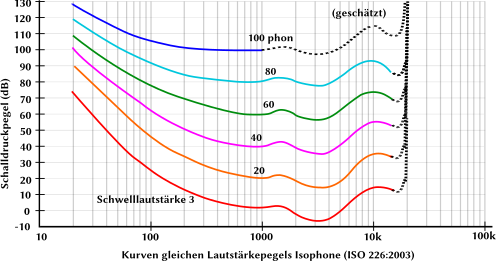

Dies zeigt sich in der sog. Hörcharakteristik.

Auch bei diesem Diagramm ist die x-Achse die Frequenz und die y-Achse der Schallpegel.

In dem Diagramm sind nun eine Reihe sogenannter Isophone eingetragen.

Das sind Kurven gleicher subjektiver Lautheit, d.h. welche Frequenz-Schallpegel-Paare

als gleich laut empfunden werden und deren Lautheit der betrachteten Isophone entspricht.

Die Einheit Phon ist dabei ein Maß für den subjektiven Lautstärkepegel.

Hier wird die Lautheit eines Schalls verglichen mit der Lautheit eines Referenzschalls:

der Wert in Phon gibt an, welchen Schalldruckpegel (in dB) ein 1000 Hz Sinuston haben müsste,

damit er als gleich laut empfunden würde wie der zu messende Schall

(d.h. bei 1000 Hz entspricht die Isophone dem Schalldruckpegel!).

Übrigens gibt es neben der Frequenz und der Amplitude bei einer Sinusfunktion eigentlich noch einen weiteren Parameter, nämlich die Phase oder die Phasenverschiebung φ . Dieser Wert gibt an, um wieviel die gesamte Funktion nach links oder nach rechts horizontal verschoben ist, d.h. um welchen Winkel die Sinusfunktion bei t=0 verschoben ist. Für die mathematische Behandlung der Sinusfunktion spielt die Phase zwar eine große Rolle, nicht aber in der auditiven Wahrnehmung, denn der Mensch kann Unterschiede in der Phase nicht direkt hören.

3. Digitale Signalverarbeitung

3.1 Sampling

Das Schallsignal ist eigentlich ein analoges, stetiges Signal. Zu jedem beliebigen Zeitpunkt liegt ein beliebig fein abgestufter Schallpegel vor. Registriert man den Schall mit Hilfe eines Sensors (z.B. eines Mikrophons) auf einem x-y-Schreiber, so erhält man eine Kurve, die sowohl in x-Richtung als auch in y-Richtung kontinuierlich ist.

Soll nun ein Schallsignal auf einem digitalen Computer dargestellt, ausgewertet oder verarbeitet werden, so muss man es digitalisieren. Einen solchen Vorgang nennt man Analog-Digitalwandlung oder Sampling. Der Schallpegel wird sowohl zeitdiskret als auch wertemäßig quantisiert abgetastet. Notgedrungen ergeben sich dadurch Abweichungen vom Originalsignal, ein sog. Quantisierungsrauschen.

Einerseits wird der Wert des analogen Signals nur an bestimmten, fest vorgegebenen Zeitpunkten erfasst (abgetastet). Die zeitliche Auflösung ist definiert durch die Länge (Dauer) der Abtastuntervalle Ts bzw. durch die Abtastfrequenz fs (Abtastrate, Samplingrate, Samplingfrequenz). Diese ergibt sich aus der Anzahl der Abtastintervalle pro Sekunde:

Übliche Werte für die Abtastfrequenz sind:

- 8 kHz (Telefon)

- 44,1 kHz (Audio-CD

- 48 kHz (Film)

- 96 kHz (Tonstudio)

Andererseits sind bei der Abtastung die Werte auf der y-Achse, d.h. der Schallpegel (Schalldruck, Amplituden) nicht beliebig fein abgestuft. Die Feinheit hängt von der Samplingtiefe (Bittiefe, Bitbreite, Auflösung), d.h. von der Feinheit der gesampelten Werte ab. Das Ergebnis ist ein diskretes Signal, d.h. eine Folge von diskreten Zahlen aus einem endlichen Zahlenraum. Die Samplingtiefe wird im allgemeinen in Bit angegeben. Übliche Werte sind (in Klammern ist jeweils die Anzahl der möglichen Abstufungen angegeben):

- 8 Bit (2^8 = 256)

- 12 Bit (2^12 = 4.096)

- 16 Bit (2^16 = 65536): Musik-CD

- 24 Bit (2^24 = 16.777.216): Tonstudio

- 32 Bit (2^32 = 4.294.967.296): Tonstudio

In der Musikproduktion werden in der Regel für den Raumklang Mehrkanal-Tonsysteme eingesetzt, so dass bei hoher Samplingrate und hoher Samplingtiefe schnell große Datenmengen zusammen kommen. So fallen beispielsweise bei einer Stereo-Aufnahnme pro Sekunde 176,4 kBytes (2 x 44100 x 2 Bytes) Daten an. Bei manchen Audioformaten (WAV, AIFF, ...) werden die Sounddaten auch verlustfrei und unkomprimiert gespeichert. Für den täglichen Gebrauch spielen aber auch andere Soundformate wie MP3 oder OGG eine wichtige Rolle. Diese beruhen einerseits auf standardisierten Komprimierungsverfahren, andererseits werden bestimmte psychoakustische Gesetze für eine Reduktion der Informationsmenge zugrundegelegt.

Eine wichtige Rolle für die Abtastung eines zeitkontinuierlichen Signals spielt das Nyquist–Shannon-Abtasttheorem. Es bezieht sich auf die Dichte der Stützstellen, d.h. die Abtastfrequenz fa. Diese muss mindestens doppelt so groß sein wie der höchste zu untersuchende Frequenzanteil im gemessenen Signal (diese Frequenz wird mit Nyquist-Frequenz fN bezeichnet): Dann nämlich lässt sich das ursprüngliche Signal auch exakt wiederherstellen. Dieser Satz gilt übrigens für jede Art von Digitalisierung, nicht nur für Schallsignale.

Wird die Abtastfrequenz zu klein gewählt, treten im digitalisierten Signal sog. Alias-Effekte in Form von Mehrdeutigkeiten oder Verzerrungen auf, Effekte, die im Original nicht enthalten sind. Das Ergebnis können Verzerrung, der Verlust wichtiger Details und das Auftreten von Artefakten sein, die es im ursprünglichen Signal nicht gab (siehe z.B. beim Film das scheinbare Rückwärtslaufen eines vorwärts drehenden Rades bei niedriger Bildwiederholfrequenz). In extremsten Fall, falls die Abtastfrequenz gleich der Nyquistfrequenz ist, ergibt die Abtastung eine konstante Funktion.

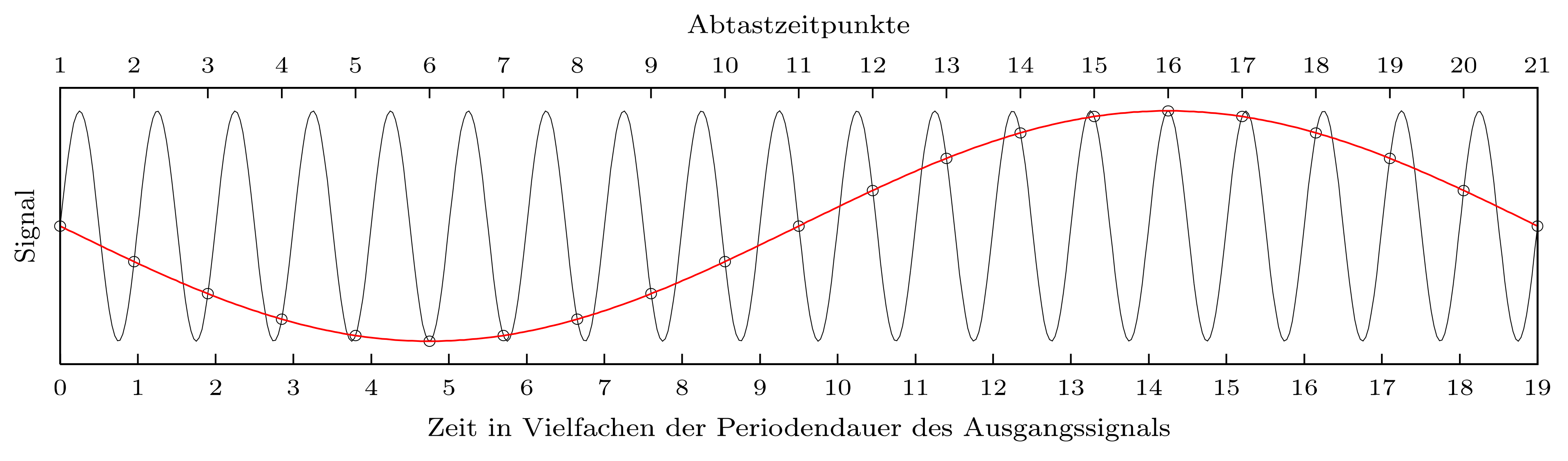

Beispiel für einen Aliasing-Artefakt bei Wikipedia:

In der Abbildung hat das Signal 19 Perioden, es wurden 21 Abtastungen durchgeführt, das rekonstruiertes Signal hat aber nur eine einzige Periode anstatt 19.

Ein akustisches Beispiel stammt ebenfalls aus Wikipedia:

-

16kHz Abtastung

Das erste Klangbeispiel lässt einen Ton erklingen, dessen Frequenz von ca. 100 Hz bis über 8000 Hz linear zunimmt. -

8kHz Abtastung

Das zweite Klangbeispiel gibt fast das gleiche Signal wieder, dieses Mal mit 8000 Hz abgetastet. Durch Unterabtastung werden Töne oberhalb von 4000 Hz falsch ausgewählt mit dem Ergebnis, dass eine Tonhöhe aufgezeichnet wird, die erst ansteigt und dann abfällt, anstatt weiter anzusteigen.

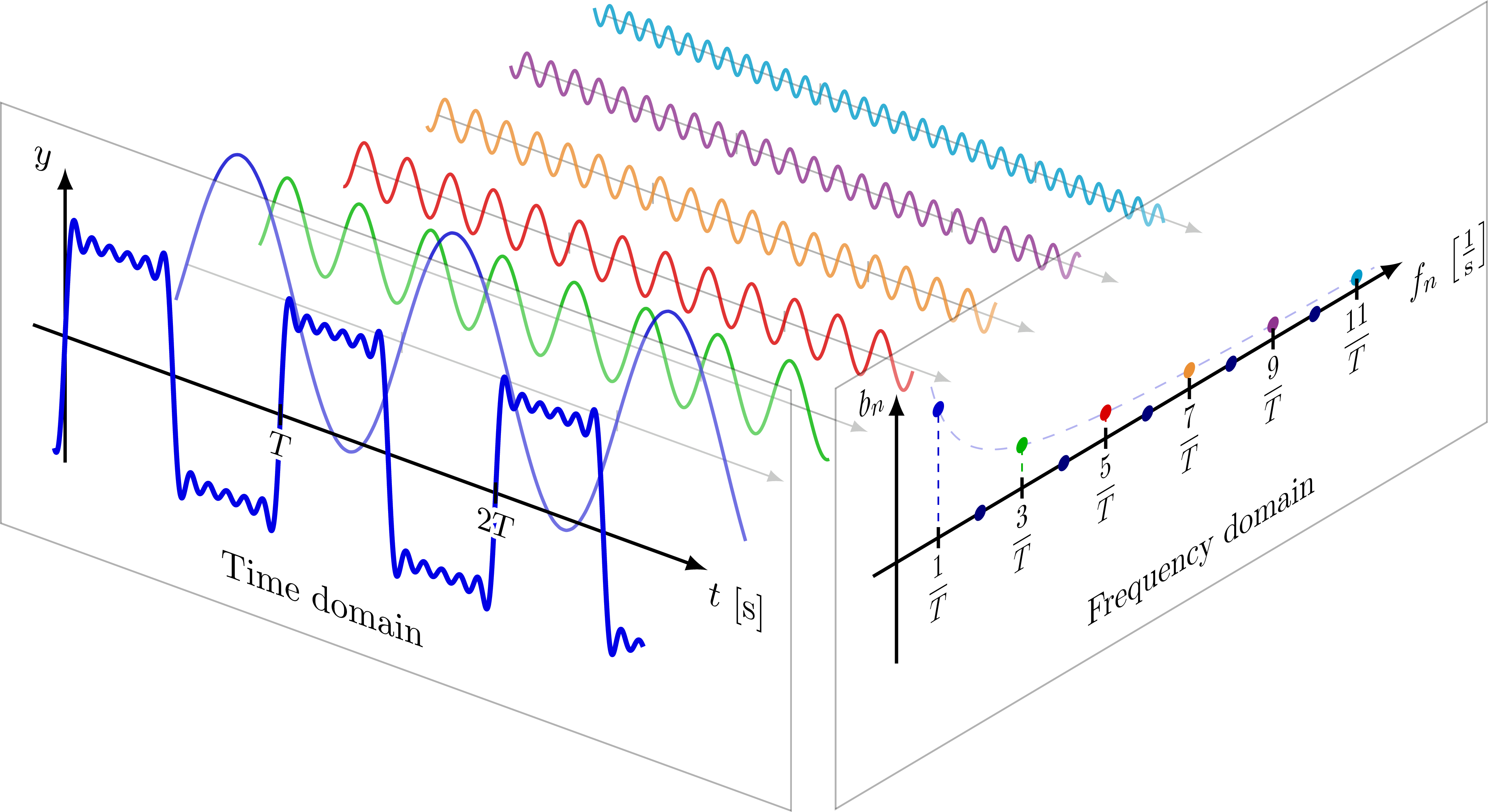

3.2 Fourieranalyse

Eine zentrale Bedeutung in der Signalverarbeitung, vor allem auch bei akustischen Signalen, bildet die Fourier-Analyse oder harmonische Analyse: kurz gesagt wird dabei ein zeitliches periodisches Signal in seine elementaren Komponenten, nämlich die in ihm enthaltenen Frequenzen zerlegt. Diese Zerlegung ist eindeutig und umkehrbar, d.h. durch Überlagerung der Komponenten lässt sich das Originalsignal rekonstruieren.

In seiner mathematisch allgemeinen Form besagt der Satz, dass jede periodische Funktion f(t) mit der Periode T sich durch eine "Fourier-Reihe"

darstellen lässt, das sind Sinus- und Kosinusfunktionen, deren Frequenzen ganzzahlige Vielfache der Grundfrequenz ω=2π/T sind:

- t: Zeit (0...Ende der Aufzeichnung)

- ω=2π/T: Grundharmonische, Grundfrequenz

- k: Nummer der Harmonischen (1, 2, 3, ...), ganzzahlige Vielfache der Grundfrequenz ω

Bei jedem Summanden, d.h. für jede Harmonische, steht hier jeweils der Sinus und der Cosinus zum Winkel (2π/T)kt,

allerdings mit jeweils verschiedenen Koeffizienten (d.h. Gewichten) ak und bk.

Die Fourierkoeffizienten ak und bk entsprechen den Amplituden der entsprechenden Harmonischen.

Sie sind durch folgende Integrale über die Länge einer Periode definiert:

Die Konstante a0 schließlich ist das Integral (die Fläche) unter der Originalfunktion f über die Länge einer Periode.

Die Koeffizienten ak sind Null, wenn die Funktion punktsymmetrisch ist,

(d.h. wenn die Funktion bei t=0 gleich 0 ist (?)).

Die Koeffizienten bk sind Null, wenn die Funktion achsensymmetrisch ist,

(d.h. wenn die Funktion bei t=0 den maximalen Ausschlag aufweist (?)).

Nebenbei bemerkt könnte man sich auf den Sinus beschränken, wenn man neben den Frequenzen auch die Phasen hinzunähme:

unter dem Summenzeichen stünde dann: cksin((2π/T)kt + φk) mit irgendwelchen Koeffizienten ck.

Für Schallwellen und speziell für die auditive Wahrnehmung vereinfacht sich nun die Situation erheblich:

- a0 ist Null, da ein Schallsignal symmetrisch um die x-Achse verläuft, d.h. die Flächen oberhalb und unterhalb der x-Achse sind gleich.

- Das Schallsignal beginnt zum Start (t=0) bei Null, d.h. die Funktion ist punktsymmetrisch. Also fallen die Kosinuskomponenten weg. Oder andersherum gesagt: die Phase einer periodischen Schwingung wäre für die auditive Wahrnehmung eh nicht relevant.

- In der Praxis müssen nicht unendlich viele Sinusfunktionen berücksichtigt werden, da Frequenzen oberhalb von 20kHz wegen der oberen Hörschwelle nicht wahrnehmbar sind.

Das Ergebnis einer Fourieranalyse ist das Frequenzspektrum (oder kurz Spektrum genannt). Die Funktion f, die ursprünglich im sog. Zeitbereich (Zeitraum) definiert ist, wird damit im Frequenzbereich (Frequenzraum) dargestellt: hier ist für jede Harmonische (d.h. für jede beteiligte Sinusfunktion) ablesbar, mit welchem Gewicht sie in der Funktion vertreten ist. Die graphische Darstellung des (eines) Spektrums ist ein Liniendiagramm (Linienspektrum), in dem für jeden der Werte k=1,2,3, ... eine senkrechte Linie mit der entsprechenden Länge eingetragen ist. Wenn also ω die Grundfrequenz ist, so entsprechen die einzelnen Linien des Spektrums also den Frequenzen ω, 2ω, 3ω, usw.

Bei der Fourier-Transformierten eines Signals, d.h. in seinem Spektrum, ist die Information über die Zeit nur noch indirekt vorhanden.

Einige bei der Konstruktion von Synthesizern wichtige Signaltypen und deren Spektren sind:

- Sinus: sin(ω)

(nur die Grundfrequenz ist vorhanden) - Rechteck: sin(ω) + 1/3 sin(3ω) + 1/5 sin(5ω) + 1/7 sin(7ω) + ...

(nur die ungeraden Vielfachen mit Gewicht 1/k sind beteiligt) - Sägezahn: sin(ω) + 1/2 sin(2ω) + 1/3 sin(3ω) + 1/4 sin(4ω) + ...

(alle Vielfachen k mit Gewicht 1/k sind beteiligt) - Impulswelle: sin(ω) + sin(2ω) + sin(3ω) + sin(4ω) + ...

(alle Vielfachen mit Gewicht 1 sind beteiligt)

Durch Hinzunahme von jeweils weiteren Komponenten kann die Approximation immer genauer werden.

Die Überlagerung von mehreren Sinuskomponenten und deren Veranschaulichung durch die entsprechenden Bewegungen auf dem Einheitskreis zeigt das folgende

JavaScript-Programm.

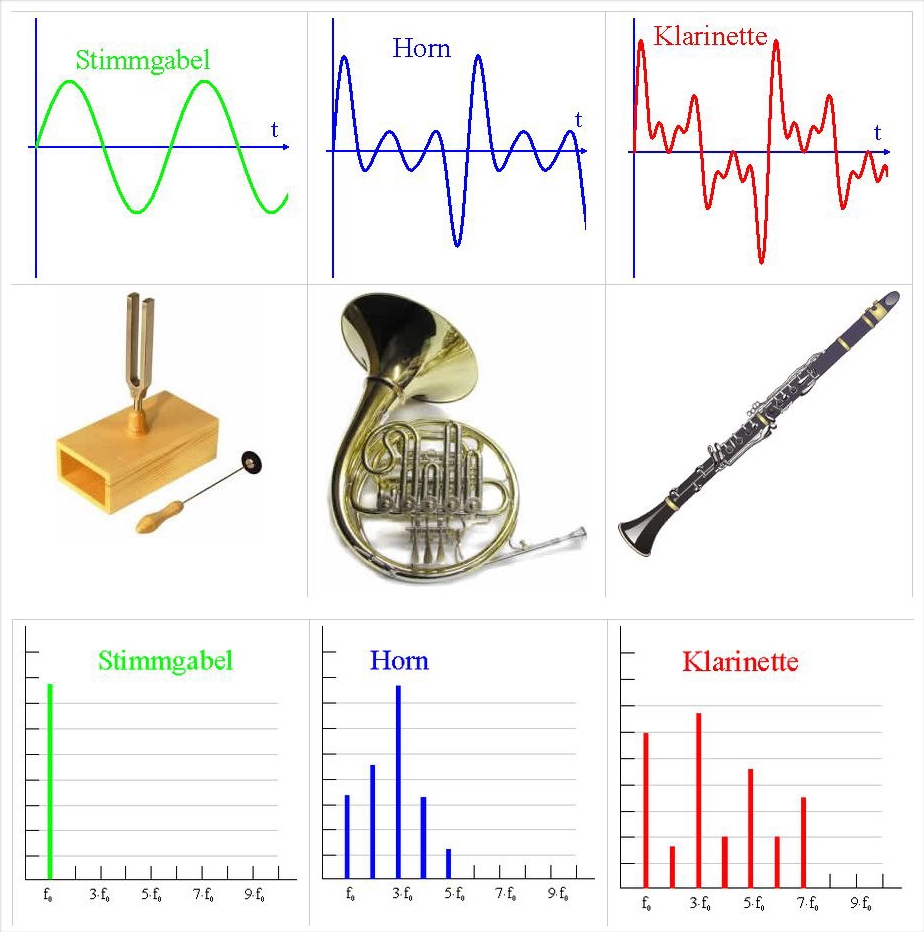

Generell ist bei allen periodischen Signalen die Frequenz des Grundtons ausschlaggebend für die wahrgenommene Tonhöhe und die höheren Spektralkomponenten ausschlaggebend für die Klangfarbe. Das Gleiche gilt auch für Musikinstrumente, d.h. für musikalische Töne: der Grundton bestimmt die Tonhöhe und die Obertöne bestimmen die Klangfarbe. So kann jedes Instrument (innerhalb seiner Möglichkeiten) den gleichen Ton wie andere Instrumente spielen, aber es hat seinen eigenen Klang bzw. - z.B. je nach Spielweise - seine eigenen Klangspektren.

Beipiele:

-

Der Ton einer Stimmgabel kommt einem reinen Sinuston recht nahe (in der Grafik wird hier die Grundfrequenz mit f0 bezeichnet):

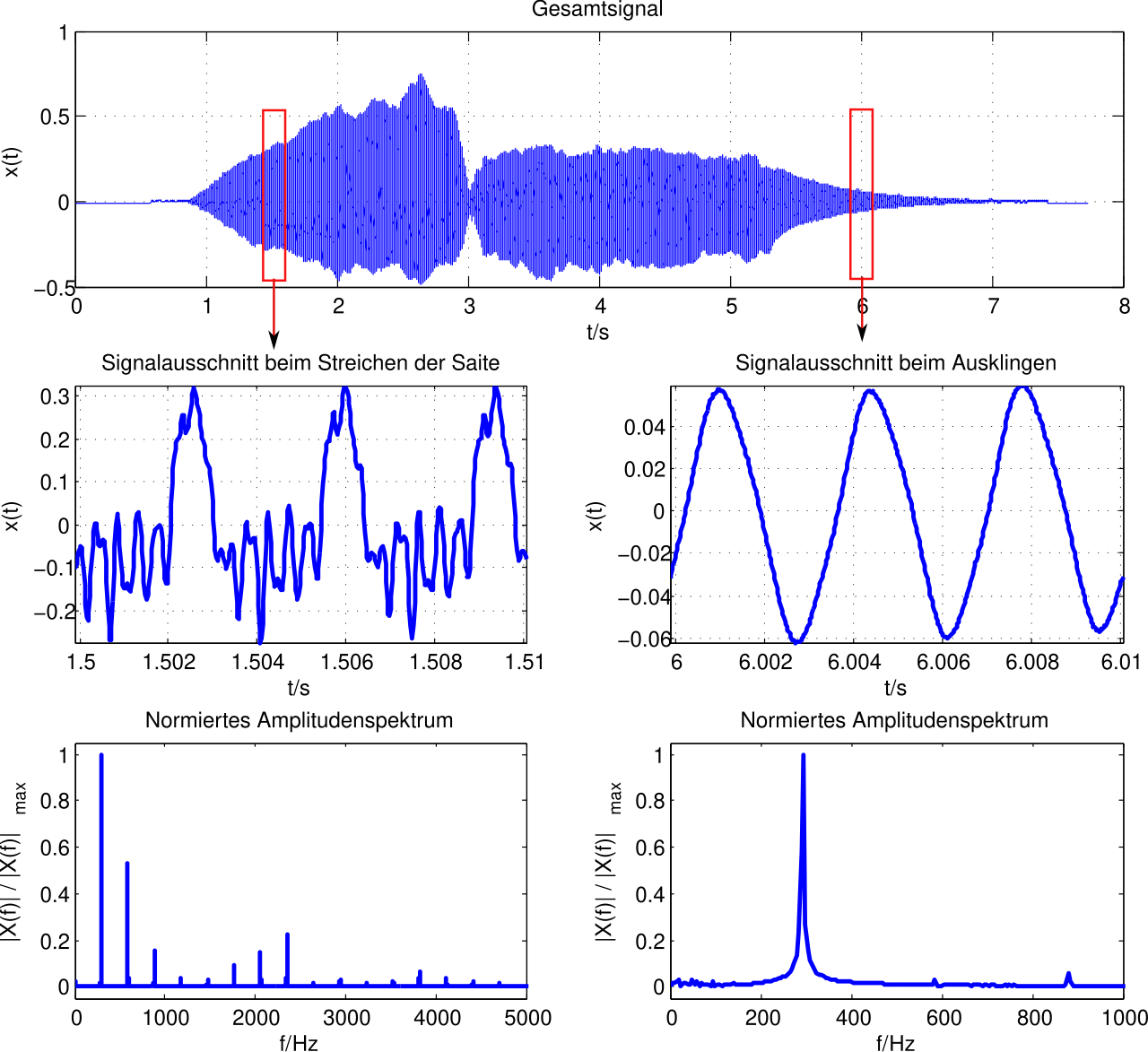

- Beispiel für einen Geigenton(aus Wikipedia):

In der Grafik sieht man

- Oben: die Original Schallwelle (Dauer: 8 Sekunden)

- Mitte: jeweils drei Perioden aus den roten Ausschnitten von oben

- Unten: das Frequenzspektrum der beiden Ausschnitte

-

Weitere Musikinstrumente mit deren Schallwelle (fast 2 Perioden) und dem Spektrum:

- Mehr Beipiele dazu findet man bei https://www.aplu.ch/overtone/hauser/.

Neben den Parametern Amplitude und Frequenz, die bei einem Ton oder Schall die Laustärke bzw. die Tonhöhe bestimmen, gibt es wie oben erwähnt einen weiteren wichtigen Parameter, nämlich das Spektrum, das für die Klangfarbe verantwortlich ist.

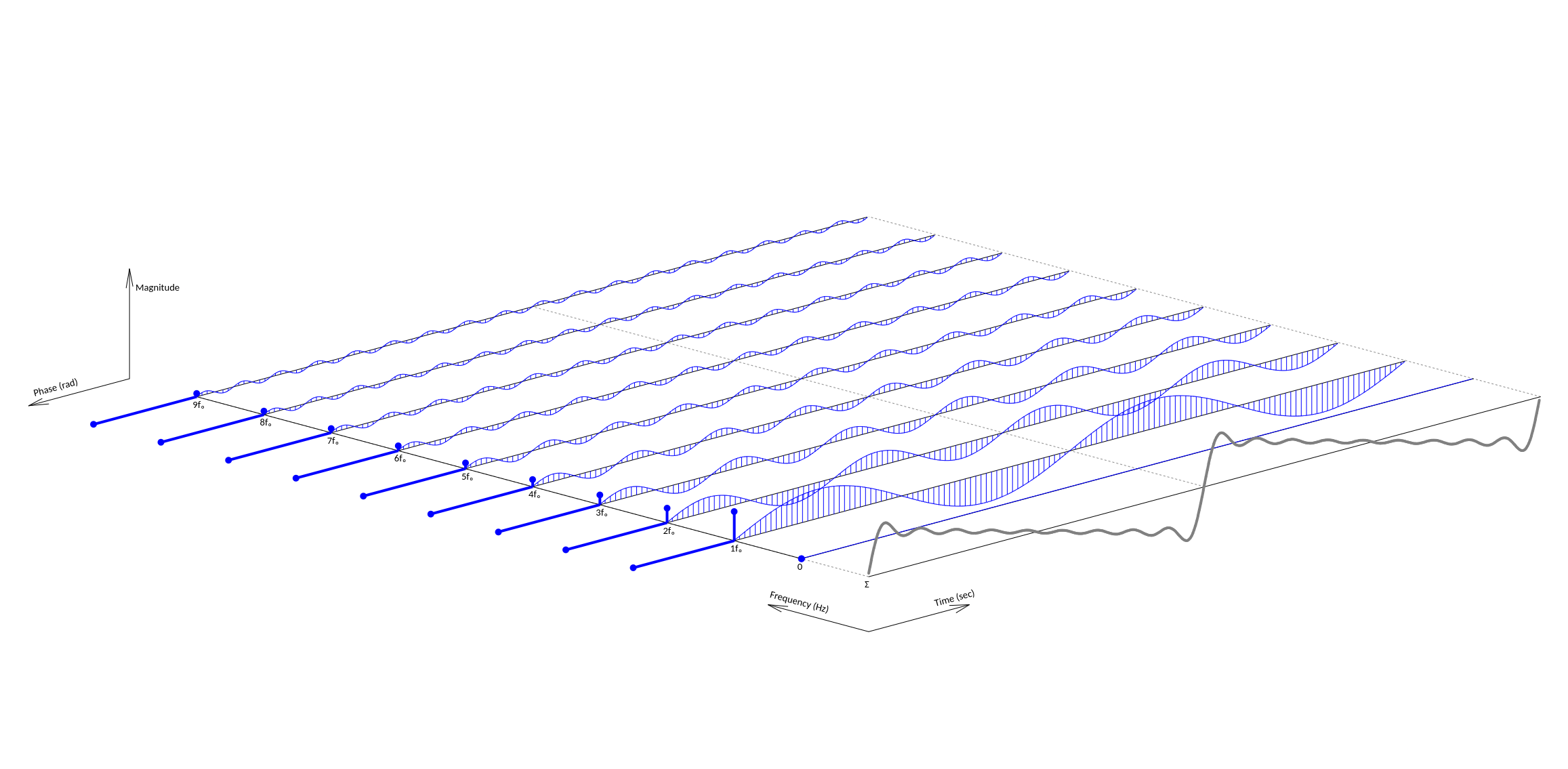

Ein Spektrum kann auch in einer 3D-Grafik veranschaulicht werden: die x-Achse ist die Zeit, die y-Achse die Frequenz und die z-Achse die jeweilige Amplitude pro Frequenz.

Als Beispiel sei hier die Annäherung an die Rechteckschwingung zu sehen:

Hier eine andere Grafik (Annäherung an die Sägezahnschwingung):

Das Spektrum kann man aber auch für Signale bestimmen, deren Sinuskomponenten nicht Vielfache einer Grundschwingung f0 sind. Vielfache der Grundschwingung bezeichnet man üblicherweise als Obertöne oder Harmonische. Dabei gibt es allerdings einen Unterschied bei der Nummerierung: z.B. wird 2f0 als der erste Oberton bezeichnet, aber als die zweite Harmonische, die erste Harmonische ist der Grundton und die Obertöne beginnen erst bei seinen Vielfachen. Generell bezeichnet man Sinuskomponenten, auch jene, die keine Vielfachen sind, als Partialtöne.

Ob das Spektrum eines Musikinstruments harmonisch ist, hängt von der Form seiner schwingenden Teile ab (Saite, Luftsäule, Stab, Membran, ...) und auch von der Art der Klangerzeugung.

Ein Beispiel für ein Instrument mit nicht-harmonischen Partialtönen ist das Glockenspiel.

Beim Glockenspielton kann man eindeutig eine Lautstärke, eine Tonhöhe und eine Klangfarbe erkennen.

Sein Spektrum ist aber nicht harmonisch, denn die Frequenz des zweitniedrigsten Partialtons liegt beispielsweise bei 2,76 f0 und nicht bei 2 f0.

Es ist dies also kein Oberton.

Bei periodischen Signalen enthält der Frequenzraum des Spektrums generell nur ganz bestimmte Frequenzen, wenn auch vielleicht unendlich viele. Das bedeutet, dass die Frequenz-Skala (y-Achse) diskret ist.

Das Spektrum kann aber auch für Signale bestimmt werden, die weder periodisch sind noch eine Grundschwingung oder deren Vielfache enthalten. In diesem Fall kann das Signal ebenfalls durch eine Fourier-Analyse als eine Überlagerung von (unendlich vielen) Sinuskomponenten dargestellt werden. Das Ergebnis ist dann aber ein kontinuierliches Spektrum, d.h. die y-Achse ist kontinuierlich und die Frequenz eine stetige Größe.

Signale dieser Art werden häufig neben den bisher aufgeführten Signalen in der digitalen Signalverarbeitung eingesetzt. Ein Beispiel eines solchen Signals ist der Impulsschall, das ist ein kurzes Schallereignis mit steil ansteigendem und steil abfallendem Schallpegel.

Weitere Beispiele sind jede Form von Geräuschen. Das prominenteste Beispiel davon ist das Rauschen, speziell das weiße Rauschen, in dessen Spektrum der gesamte hörbare Frequenzbereich vertreten ist mit einer Amplitude, die zufällig um einen mittleren Wert schwankt.

Die bisherigen Ausführungen zum Spektrum von Musikinstrumenten waren statisch und idealisiert. In der Praxis ist die Situation jedoch dynamisch, d.h. das Spektrum eines Instruments ändert sich meist im Laufe eines Tons. Außerdem sind bei jedem Instrument auch unharmonische Passagen (Teile), z.B. Geräusche beim Anspielen, zu hören. Solche Schallreize gehören im allgemeinen auch zum Wesen des Instruments und der Spielweise. Andersherum ist ein Musikinstrument oft schwer zu identifizieren, wenn man nur einen Ausschnitt aus der "stationären Phase" eines Tons zu hören bekommt.

Eine weitere Annahme, die den bisherigen Ausführungen zugrunde lag, war die Annahme oder Voraussetzung, dass das Signal zeitlich unbegrenzt ist. Praktisch ist aber jede Aufzeichnung zeitlich begrenzt. Als Folge des Abschneidefehlers ergibt sich eine Verbreiterung, eine Unschärfe im Linienspektrum.

Zusammenfassend kann man sagen, dass eine Fourier Analyse immer ein Signal von der Zeitdomäne in die Frequenzdomäne transformiert. Daher spricht man auch allgemein von einer Fourier-Transformation.

Je nach Art des Signals und je nach Art der Aufzeichnung kann man verschiedene Klassen von Fourier-Transformationen unterscheiden. In unserem Zusammenhang (Fall), nämlich bei diskreten und periodische Daten, ist die bisher dargestellte Diskrete Fourier Transformation (DFT) anzuwenden. Davon gibt es auch eine spezielle, häufig verwendete Variante, nämlich die Fast Fourier Transformation (FFT). Sie erlaubt eine besonders effiziente Berechnung des Spektrums, falls nämlich die Anzahl der Samples eine Potenz von 2 ist.

Für kontinuierliche nicht-periodische Signale hingegen ist eine andere Art von Transformation anzuwenden, nämlich das Fourier-Integral. [In der Formel zur Diskreten Fourieranalyse steht eine Summe über die Vielfachen der Grundschwingung - hier steht nun ein Integral über die gesamte Frequenzskala (alle möglichen Frequenzwerte); ein Integral ist ja die Verallgemeinerung einer Summe bei stetigen Daten.]

Erwähnt werden soll außerdem noch die Inverse Fourier Transform (IFT und IFFT), die versucht, umgekehrt aus dem Spektrum wieder das Zeitsignal zu rekonstruieren.

Schließlich sei noch gesagt, dass die Fourieranalyse nicht nur in der Akustik, sondern auch in anderen Disziplinen wie in der Optik oder in der Astrophysik mit großem Erfolg zur Anwendung kommt.

3.3 Die Hüllkurve

Das zeitliche Verhalten eines einzelnen Tones ist in der Realität normalerweise durch eine Funktion zu beschreiben, deren Frequenz zwar konstant, deren Amplitude aber meist nicht konstant ist. Wenn beispielsweise eine Stimmgabel angeschlagen wird, beginnt sie zu schwingen. Sie schwingt mit konstanter Frequenz, aber die Amplitude der Schwingung ändert sich systematisch, sie wird immer kleiner, bis die Schwingung ganz aufhört. Man spricht hier von einer gedämpften Schwingung.

Allgemein wird die Amplitude einer Schwingung in Abhängigkeit von der Zeit durch eine sog. Hüllkurve beschrieben. Die Original-Schwingung wird sozusagen überlagert von ihrer Hüllkurve.

Die bekannteste Hüllkurve ist die ADSR Hüllkurve. Dabei werden verschiedene Phasen unterschieden:

- Attack: Dauer der Einschwingphase

- Decay: Dauer des anschließenden Abfalls

- Sustain-Level: Amplitude des gehaltenen Tons

- Release: Dauer der Ausschwingphase (Ausklingphase)

Zum Explorieren einer Hüllkurve eignet sich das folgende JavaScript-Programm.

Man beachte dabei, dass A, D, und R Zeiten sind und S eine Amplitude. Man beachte außerdem, dass die ADSR-Hüllkurve eine Vereinfachung darstellt. Sie ist nämlich eine stückweise lineare Funktion.

3.4 Die additive Synthese

Bei der Beschäftigung mit der Fourier-Analyse könnte man auf die Idee kommen, den umgekehrten Weg zu gehen und eine Fourier-Synthese durchzuführen. Dabei nimmt man irgendwelche Sinuswellen als Ausgangsmaterial und erzeugt durch deren Überlagerung einen komplexen Klang. Dieses Vorgehen nennt man additive Synthese.

Bei einem solchen Experiment ist man auch nicht darin eingeschränkt, ausschließlich ganzzahlige Vielfache einer Grundfrequenz zu verwenden. Man kann auf diese Weise irgendwelche beliebige, auch mehrstimmige Klänge herstellen.

Mit derartigen Experimenten lassen sich auf künstlichem Wege auch Schwebungen erzeugen. Diese treten als Resultierende einer Überlagerung von zwei Schwingungen auf, deren Frequenzen sich nur geringfügig voneinander unterscheiden. Das Ergebnis ist ein modulierter Ton, ein pulsierendes Signal oder eine Reibung mit periodisch zu- und abnehmender Amplitude. Die Frequenz des Pulsierens entspricht der Differenz der beiden einzelnen Frequenzen und die resultierende Tonhöhe ihrem Mittelwert. Schwebungen spielen in der Musik und bei der Musizierpraxis eine große Rolle. Zum Explorieren von Schwebungen eignet sich das folgende JavaScript-Programm.

3.5 Die subtraktive Synthese

Bei der subtraktiven Synthese hingegen werden aus einem vorgegebenen komplexen Klang einzelne Komponenten entfernt.

Überdies ist es natürlich auch möglich, beide Formen der Synthese zu mischen, d.h. ein vorgegebenes spektrales Muster zu verändern, indem man nicht nur einzelne Komponenten entfernt oder deren Amplitudenwerte verändert und zusätzlich neue Komponenten hinzufügt. Solche Möglichkeiten kann man mit dem folgenden JavaScript-Programm explorieren.

So wird dann aus einem beliebigen, vorgegebenen Spektrum ein Zeitsignal, d.h. ein Klang erzeugt. Techniken dieser Art werden bei der digitalen Klangerzeugung, beim Sound Design (Tongestaltung), angewandt.

Vor allem bei der Konstruktion von Synthesizern spielt die subtraktive Synthese eine entscheidende Rolle. Das Vorgehen ist hierbei meist so, dass aus einem anfänglich möglichst obertonreichen Klang durch Filter einzene Komponenten abgezogen und der Klang anschließend noch in verschiedener Weise geformt wird.

.......................................................... weitere Themen .............................................................

3.6 Synthesizertechnik (Klangformung)

Die letzten Ausführungen führen zu einer technisch ausgereiften und weit verbreiteten Form der Klangsynthese und Klangbearbeitung, zum Synthesizer. Beim klassischen Synthesizer beginnt die Soundkette meist beim Klangerzeuger, dem Oszillator. Dort werden Wellenformen erzeugt, die viele Obertöne enthalten. Anschließend gelangt dass Signal in das Filter, ein für die subtraktive Synthese entscheidender Schritt. Hier werden gezielt bestimmte Frequenzbereiche abgeschwächt oder hervorgehoben und der Charakter des Sounds modelliert. Am Ende der Kette folgen meist noch niederfrequente Oszillatoren (LFOs), Effektgeräte zur weiteren Modulation des Sounds, sowie Hüllkurvengenerator, Mixer und Verstärker.

Im Detail besteht ein Synthesizer allgemein also aus folgenden Komponenten, die im einfachsten Fall der Reihe nach durchlaufen werden:

- Eine Steuereinheit mit verschiedenen Bedienungselementen für die einzelnen Komponenten des Systems und einer Tastatur, über die die Sounds gespielt werden können.

-

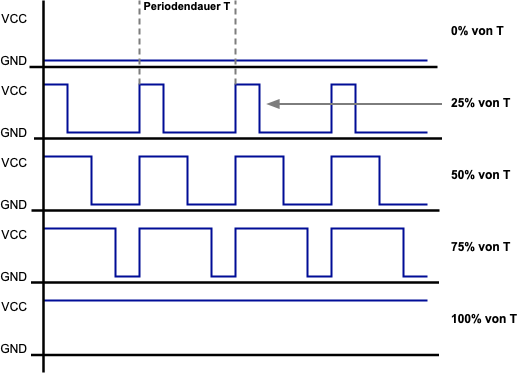

Ein oder meist mehrere Oszillatoren (VCOs) als Klangerzeuger.

Ihr Zweck ist die Erzeugung eines obertonreichen Tons. Im Angebot befinden sich normalerweise die klassischen Wellenformen Sinus, Dreieck, Rechteck und Sägezahn. Häufig findet man auch noch einen Rauschgenerator. Beim Sägezahn steht manchmal auch die Vorwärts- und Rückwärtssägezahnwelle zur Verfügung. Bei der Rechteckwelle lässt sich oft auch die Pulsweite, das ist das Längenverhältnis zwischen den positiven und den negativen Werten, verändern.

Beispiele:

Hat man mehrere Oszillatoren, so führt man ihre Signale über Mixer zusammen. Man kann die Oszillatoren sogar gegeneinander verstimmen. Es gibt also viele Möglichkeiten, ein möglichst obertonreiches Signal als Ausgangsmaterial zu erzeugen. - Filter ...

Das Filter ist das Herzstück der subtraktiven Synthese, es ist im Grunde ein Frequenz-Gate. Es eröffnet spezielle Möglichkeiten moderner Klanggestaltung nach dem Grundprinzip, dass es bestimmte Frequenzen durchlässt und andere entfernt oder abschwächt. Überdies ist es sogar möglich, durch ein Filter Frequenzanteile hinzuzufügen. Die Arbeitsweise eines Filters ist durch verschiedene Parameter definiert:- Filtertyp

Die bekanntesten Typen sind Lowpass-, Highpass-, Bandpass- und Bandsperrfilter. Daneben gibt es noch spezielle Typen wie Kammfilter, Kerbfilter, Formantfilter, Filterbank. So werden zum Beispiel bei einem Tiefpassfilter die hohen Frequenzanteile ab einem bestimmten Wert abgeschnitten. Ein Tiefpassfilter kann übrigens auch dazu dienen, bereits bei der Digitalisierung alle Frequenzen oberhalb der Nyquist-Grenze abzuschneiden. Dadurch wird verhindert, dass Aliasing auftritt und nicht vorhandene hohe Frequenzen ins digitale Signal gelangen (s.o.). - Cutoff-Frequenz (Trennfrequenz, Eckfrequenz)

Dies ist die Frequenz, ab der das Filter Frequenzen abschneidet. Bei einem Lowpass-Filter bedeutet dies beispielsweise: alles unterhalb der Cutoff-Frequenz kommt durch und alles oberhalb wird abgeschnitten. Dies erfolgt aber nicht abrupt, sondern mehr oder weniger scharf. - Flankensteilheit

Diese betrifft die Pegelreduktion jenseits der Cuttoff-Frequenz. Sie wird in Dezibel pro Oktave angegeben. Übliche Werte sind 6dB, 12dB, 18dB, 24dB. Je höher der Wert ist, desto steiler fällt die Kurve ab und desto trennschärfer wirkt das Filter. - Resonanz

Dieser Parameter betont oder dämpft das Signal im Bereich der Cutoff-Frequenz, d.h. das Spektrum bekommt dort einen kleinen Buckel. Eine hohe Resonanz verstärkt durch Rückkopplung den Pegel an der Cutoff-Grenze. Bei sehr hoher Resonanz kann das Filter anfangen, selbst zu schwingen, was zu einer Sinus-Oszillation führen kann, die hörbar ist.

- Filtertyp

- LFO-Oszillator

LFO: Modulator, Modifikator (auch ein Oszillator, nur kein Klangerzeuger) Rate, Wellenform Vibrato, Tremolo (Tonhöhenmodulation), Filtertrennfrequenz, ... Modulatoren (Hüllkurvengeneratoren für Filtersektion, LFO) Modulare Systeme Der bekannte Tremolo-Effekt steigert sich bis zu einer eigentümlichen Rauheit des Klanges; man spricht hier von subauditiver Steuerung. Erst durch die Erhöhung der LFO-Frequenz in den menschlichen Hörbereich entsteht ein stationärer Klang. -

Verstärker (VCA), Hüllkurvengenerator für Verstärkersektion

3.7 Wavetable-Synthese (Frequenzmodulation)

Die Wavetable-Synthese (englisch Wavetable = Wellentabelle) ... ist eine Methode der Klangsynthese und wird beispielsweise in Synthesizern und Soundkarten eingesetzt. ... Bei der Wavetable-Synthese wird ein Klang durch das Abspielen und dynamische Überblenden zwischen digital gespeicherten Wellenformen (Wavetables) erzeugt. Das Verfahren wurde in der ursprünglichen Bedeutung Ende der 1970er Jahre von Wolfgang Palm eingeführt und stellt eine spezielle Form des Abspielens von Audiosamples dar. Charakteristisches Merkmal der Wavetable-Synthese ist der digitale Wellenformgenerator.[1] Im Laufe der Zeit wurde der Begriff für unterschiedliche Arten der sample-basierten Klangsynthese verwendet. siehe https://de.wikipedia.org/wiki/Wavetable-Synthese Samplebasierte Synthese Wavetable von Ableton (https://www.ableton.com/de/packs/wavetable/) Wavetable ist der neue Synth, der ganz intuitiv spielbar und extrem vielseitig ist. Erweitern Sie Ihre Soundpalette durch Stretchen, Modellieren und Morphen von Wellenformen. Die Wavetables stammen von Synths, akustischen Instrumenten, Noise und vielem mehr. Spielen Sie einfach drauflos oder bohren Sie sich tiefer in die Klangsynthese hinein als je zuvor. Für Wavetables satten Sound sorgen zwei Hauptoszillatoren (sowie ein dritter Suboszillator). Damit können Sie Hunderte Wavetables anpassen und morphen, die den Klang akustischer oder synthetischer Instrumente sowie klassische Wellenformen abbilden. Zwei flexible virtuell-analoge Filter mit Morphingfunktion und spezielle Unison-Modi reichern den Sound noch zusätzlich an.

3.8 FM-Synthese (Frequenzmodulation)

..................................... dieser Text wird demnächst fortgesetzt ..........................................

Empfehlenswerte Literatur

Für einen tieferen Einstieg in die Materie sei die folgende ausgezeichnete Literatur empfohlen. Trotz älteren Datums sind die Werke immer noch aktuell. Von den Schwerpunkten unterscheiden sie sich etwas, aber von den Inhalten und der Darstellung überlappen sie sich weitgehend.

- Physikalische Grundlagen: Akustik und Sound

- Pierce, John R.: Klang, Musik mit den Ohren der Physik. Spektrum Verlag, Heidelberg, ohne Jahr.

- Borucki, Hans: Einführung in die Akustik. B.I.-Wissenschaftsveröag, Mannheim, 1980.

- Rossing, Thomas D.: The Science of Sound. Addison-Wesley, Reading, 1982.

- Benade, Arthur H.: Fundamentals of Musical Acoustics. Dover Publication, New York, 1976.

- Eska, G.: Schall und Klang. Birkhäuser, Basel, 1997.

- Neuronale Grundlagen: Physiologie

- Zenner, Hans-Peter:Hören. Physiologie, Biochemie, Zell- und NeurobiologieThieme Verlag, Stuttgart, 1994.

- Pickles, James O.:An Introduction to the Physiology of Hearing.Academic Press, London, 1982.

- Psychologie des Hörens

- Moore, B. C. J.: Psychology of Hearing. Academic Press, Amsterdam, 2003.

- Warren, R. M.: Auditory Perception. Cambridge University Press, Cambridge, 1999.

- Eska, G.: Schall und Klang. Birkhäuser, Basel, 1997.

- Psychoakustik

- Helmholtz, H. v.:Die Lehre von den Tonempfindungen als physiologische Grundĺage für die Theorie der Musik.Vieweg Verlag, 1863. Nachdruck Georg Holms Verlag, Hildesheim, 1968.

- Roederer, J. G.: Physikalische und psychoakustische Grundlagen der Musik, 3. Auflage. Springer Verlag, Berlin, 1995.

- Mein Paper zur Psychoakustik

siehe auch:

- https://www.youtube.com/watch?v=MhuS607LrdY Erklärvideo/Experiment "Überlagerung ungedämpfter Schwingungen"

- https://www.youtube.com/watch?v=7fxHcYDNwW0 Überlagerung von harmonischen Schwingungen (Schwebung | Sinus | Phasenverschiebung)

- https://www.youtube.com/watch?v=ZpEMnqqmyG8 Reflexion von Wellen an losen und festen Enden (Phasenverschiebung)

Übrigens: Lissajous-Figur (siehe Wikipedia, mein Soundsynthese-Programm) + Phasenverschiebung !!! + Amplitude !!!

siehe https://www.youtube.com/watch?v=NK1fsQWihEg